Grenzpolizist Big Brother: Migrations-Management-KI

Die folgende Erläuterung der regierungseigenen Bundeszentrale für politische Bildung (bpb) für KI im Einsatz gegen Migration (euphemistisch: „Migrationsmanagement“), erläutert einige Aspekte dieser Problematik. Seit 9/11 führen nicht nur die USA, sondern offenbar „der Westen“, also auch wir, einen „Krieg gegen den Terror“, der eine Einschränkung von Bürgerrechten beinhaltet. Kontrolliert wird dabei prinzipiell jeder von uns, speziell aber die Gruppe der sogenannten „Gefährder“, die sich offenbar insbesondere bei Migranten finden lässt; ihr Merkmal ist „eine nicht näher konkretisierbare Gefährlichkeit, die sich in der Zukunft ausbilden könnte. (…) Ziel ist hierbei, schwer bestimmbare konkrete Zeitpunkte und Formen eines terroristischen Anschlags zu kontrollieren und damit auch aufsteigende Ängste in der Bevölkerung zu reagieren.“ Siehe: „Gefährder“: Der Migranten-Minority Report.

Ängste der Bevölkerung sollen also „reagiert werden“ (nicht auf sie reagieren!); ein typischer Freudscher Versprecher, bei dem die wahre Intention entschlüpfte? Sollen unsere Ängste „reagiert werden“, also reaktiviert, abreagiert oder agitiert werden? Ängste helfen Machthabern, Bevölkerungen zu kontrollieren und in ihrem Sinne zu manipulieren. Ängste machen Menschen bereit zum Hass, zur Blindheit für vernünftige Lösungen, zur fanatischen Aufrüstung und Militarisierung. Andersartige, Andersfarbige, Migranten sind dafür die naheliegenden Sündenböcke, vor denen im Sinne reaktionärer und rechtsextremer Ideologien Angst geschürt werden soll. Wo Multi-Milliarden und Billionen für Rüstung (statt für die Menschen) ausgegeben werden, fällt auch für BigTech und KI einiges ab: Die gleich genannte Überwachungsfirma ANDURIL klingt nicht zufällig ähnlich wie Peter Thiels PALANTIR. Projekte zur Emotionserkennung, KI-Lügendetektoren und vorausschauender Polizeiarbeit (engl. predictive policing) laufen bereits.

Wie dabei KI gegen Migranten eingesetzt wird erläutert für die Bundesregierung das bpb im jetzt folgenden Text von Petra Molnar. KI dient dabei für Prognosen zum Migrationsgeschehen, für Grenz- und Fernüberwachung, für Identitäts- und biometrische Systeme, Gesichtserkennung, Asyl- und Visumsbearbeitung, für die Steuerung von „Alternativen zur Inhaftierung“, die auf ständige Überwachung hinauslaufen. KI bildet den digitalen Stacheldrahtverhau auf den künftigen „smart borders“, die sozial benachteiligten Migranten jene Freizügigkeit rauben, die wohlhabenden Touristen (einstweilen noch) offensteht. Das völkerrechtlich gebotene (!) Asylrecht bleibt dabei auf der Strecke, wenn automatisierte Entscheidungen mit digitalem racial Bias oder ähnlichem Unrecht fallen. (T.Barth) Folgender Text übernommen von bpb:

Künstliche Intelligenz im Migrationsmanagement: Chancen, Herausforderungen und Risiken

Petra Molnar (bpb) 04.09.2025 / 9 Minuten zu lesen

Weltweit wird künstliche Intelligenz zunehmend im Migrationsmanagement eingesetzt – auch in der EU und in Deutschland. Welche Entwicklungen, Chancen und Risiken gehen damit einher?

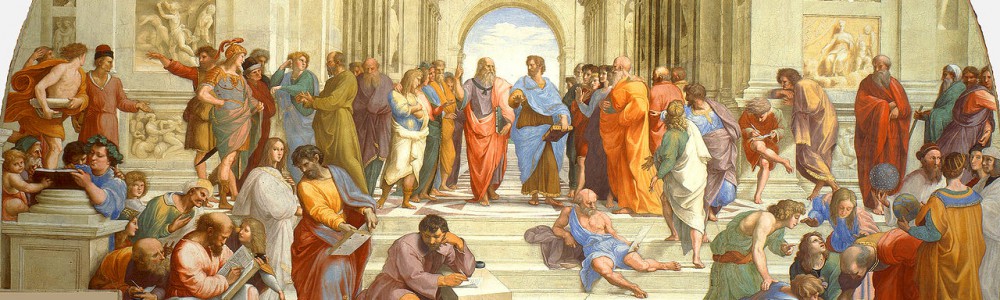

Überwachungsturm von Elbit Systems, Arizona, USA. Solche Überwachsungstürme entlang der Grenze zu Mexiko erkennen mithilfe von KI-Überwachung Bewegungen und sollen so dabei helfen, Personen in der Sonora-Wüste im Südwesten der USA abzufangen. (© Petra Molnar, Abbildungen fehlen hier aufgrund urheberrechtlicher Gründe)

verändert in rasanter Geschwindigkeit die Art und Weise, wie Regierungen Migration steuern und Grenzen kontrollieren. Von prognosebasierter Datenanalyse und Identitätsprüfung bis hin zu Grenzüberwachung und Asylentscheidungen – KI-Technologien werden zunehmend in die Infrastruktur der Migrationskontrolle in Europa und weltweit integriert. Dabei wird argumentiert, dass neue Technologien wie KI die Steuerungssysteme im Migrationsmanagement effizienter, sicherer und kostengünstiger machen können. Angesichts der aktuellen Entwicklungen im Bereich der digitalen Technologien bestehen jedoch auch ernsthafte Risiken für die Menschenrechte, die Privatsphäre und die Grundsätze des Asylrechts. Dieser Artikel basiert auf jahrelangen Forschungsarbeiten an verschiedenen Grenzen weltweit und gibt einen Überblick darüber, wie KI im Migrationsmanagement in Europa und weltweit eingesetzt wird. Wichtige Debatten über die Auswirkungen dieser Entwicklung auf Recht, Ethik und Gesellschaft werden dabei ebenfalls in den Blick genommen.

Wo und wie wird KI eingesetzt?

Weltweit und in der gesamten Europäischen Union (EU) wird KI mittlerweile in verschiedenen Phasen des Migrationsmanagements eingesetzt. Zu den wesentlichen Feldern gehören:

Grenzüberwachung: KI-gestützte Systeme werden zur Überwachung von Grenzen eingesetzt. Beispielsweise integriert das Europäische Grenzüberwachungssystem (Eurosur) Satellitenbilder, Drohnen und andere Sensordaten, die mit KI analysiert werden, um die Außengrenzen zu überwachen – insbesondere im Mittelmeerraum. An Landgrenzen und Flughäfen werden Algorithmen zur Gesichtserkennung und Objekterkennung eingesetzt, um Personen zu identifizieren, die irregulär einreisen oder als risikoreich gelten. In den Vereinigten Staaten stellen Unternehmen wie die US-amerikanische Firma Anduril autonome Überwachungstürme entlang der Südgrenze bereit, die mithilfe von KI-Überwachung Bewegungen erkennen und verfolgen und dabei helfen sollen, Personen in der Sonora-Wüste im Südwesten der USA abzufangen.

Identitäts- und biometrische Systeme: KI kann auch bei der Verarbeitung biometrischer Daten wie Fingerabdrücken, Iris-Scans und Gesichtsbildern zur Identitätsprüfung helfen. Eurodac, die EU-Datenbank, in der Fingerabdrücke von Asylbewerber:innen gespeichert werden, nutzt KI für einen effizienteren und genaueren Abgleich. In Deutschland hat das Bundesamt für Migration und Flüchtlinge (BAMF) eine Software zur Erkennung von Sprachen und Dialekten getestet, die die Herkunft von Personen, die einen Asylantrag gestellt haben, feststellen soll. Der Einsatz dieser Software hatte in der Folge Debatten darüber ausgelöst, wie genau und fair solche Systeme und ihre Ergebnisse sind. Die deutsche Bundespolizei setzt an wichtigen Verkehrsknotenpunkten und Grenzen biometrische und Gesichtserkennungstechnologien ein, darunter auch prognostische Komponenten. Gleichzeitig helfen automatisierte Dokumentenprüfsysteme dabei, gefälschte Reisedokumente zu identifizieren.

Asyl- und Visumsbearbeitung: KI-Anwendungen werden zunehmend zur Prüfung von Visums- und Asylanträgen eingesetzt. Einige Länder wie Kanada verwenden Algorithmen zum automatisierten Vorsortieren von Visumanträgen, während die Vereinigten Staaten Risikobewertungsalgorithmen einsetzen, die die Daten der Antragstellenden analysieren, um potenzielle Betrugs- oder Sicherheitsrisiken vorherzusagen, und dafür auch Daten verwenden, die aus sozialen Medien gesammelt wurden. Diese Systeme versprechen zwar Effizienz, werfen jedoch Bedenken hinsichtlich algorithmischer Verzerrungen, ordnungsgemäßer Verfahren und des Rechts auf individuelle Beurteilung auf. In Deutschland setzt das BAMF maschinelle Übersetzungsprogramme ein, um das Dolmetschen von Anhörungen im Asylverfahren und die automatisierte Dokumentenprüfung zu unterstützen. Fragen hinsichtlich ihrer Genauigkeit und möglichen Auswirkungen auf Asylentscheidungen bleiben hier bisher offen.

Prognosen zum Migrationsgeschehen: Regierungen und internationale Behörden wie die EU-Grenzschutzagentur Frontex nutzen KI zur Analyse großer Datensätze – darunter Daten aus sozialen Medien und Klimadaten –, um Migrationsmuster vorherzusagen. Diese zukunftsprognostizierenden Analysen sollen Frühwarnsysteme und die Ressourcenplanung unterstützen. Allerdings sind diese Modelle zur Vorhersage von Migrationsbewegungen oft nicht transparent. Befürchtet wird hierbei, dass sie zu präventiven Grenzschließungen oder Kontrollmaßnahmen sowie zu Aktivitäten wie dem Abfangen von Schutzsuchenden und illegalen Zurückweisungen ( Pushbacks) führen können.

Fernüberwachung und ‚Alternativen‘ zur Inhaftierung: Elektronische Fußfesseln, GPS-fähige Smartphones und Ortungsgeräte sowie KI-gesteuerte Check-in-Systeme werden als Alternativen zur Inhaftierung von Einwanderer:innen beworben, sind jedoch oft mit einer ständigen Überwachung verbunden. Diese Technologien werden in den USA, Großbritannien und anderen Ländern eingesetzt und manchmal an private Unternehmen ausgelagert.

Wer entwickelt und fördert diese Systeme?

An der Entwicklung von KI im Migrationsmanagement sind sowohl staatliche als auch privatwirtschaftliche Akteure beteiligt. Große Technologieunternehmen, Rüstungsfirmen und KI-Startups entwickeln und vermarkten Anwendungen für Regierungen. In Europa unterstützt die EU-Grenzschutzagentur Frontex technologische Innovationen, während die Finanzierung aus regionalen Forschungsprogrammen wie Horizon 2020 und dem Fonds für innere Sicherheit (ISF) stammt. Insbesondere Deutschland hat über das BAMF und die Bundespolizei in Identitätsfeststellungen anhand biometrischer Merkmale, Sprachanalyse und automatisierte Systeme zur Dokumentenanalyse investiert. An mehreren von der EU finanzierten Pilotprojekten waren auch deutsche Partner:innen beteiligt, darunter Universitäten und Forschungsinstitute.

Maritime Überwachungsdrohne auf der DEFEA-Konferenz in Athen, einer internationalen Fachausstellung für Verteidigung und Sicherheit. (© Petra Molnar)

Staaten wie die USA, Kanada und Australien sind ebenfalls führend im Bereich des Einsatzes von KI an ihren Grenzen und arbeiten häufig mit Technologieunternehmen wie den US-amerikanischen Firmen Palantir und Anduril oder der israelischen Firma Elbit Systems zusammen. Das Interesse des privaten Sektors ist Teil eines wachsenden und lukrativen, mehrere Milliarden Euro schweren „Industriekomplexes“ im Bereich der Grenzsicherung, in dem private Gewinninteressen und öffentliche Sicherheitsinteressen einander ergänzen.

Internationale Organisationen – darunter die Internationale Organisation für Migration (IOM) und das UN-Flüchtlingshilfswerk (UNHCR) – prüfen den Einsatz von KI-Anwendungen, um Menschen auf der Flucht zu registrieren, zu überwachen und Hilfsgüter zu verteilen, teilweise in Zusammenarbeit mit Partnern aus der Privatwirtschaft. Während diese Anwendungen als humanitäre Innovation dargestellt werden, werden gleichwohl oft sensible Daten unter ungleichen Machtverhältnissen gesammelt, die zwischen dem Globalen Norden und Süden oder zwischen Hilfsorganisationen und Menschen in Not bestehen.

Chancen und Versprechen

Akteur:innen, die den Einsatz von KI im Migrationsbereich befürworten, verweisen auf mehrere potenzielle Vorteile. So wird häufig Effizienz als einer der wichtigsten Treiber für den Einsatz von KI-Anwendungen genannt. Staaten, die KI einsetzen argumentieren, dass die Automatisierung von Routineaufgaben Rückstände bei der Bearbeitung von Asyl- und Visumsanträgen reduzieren, die Datenanalyse optimieren und die Koordination zwischen den Behörden verbessern kann. Ein weiterer wichtiger Treiber ist das Versprechen der Genauigkeit und die Tatsache, dass KI den biometrischen Abgleich und die Identitätsprüfung verbessern und damit Betrug und Verwaltungsfehler reduzieren kann. Im Kontext des derzeitigen Fokus auf Sicherheit, der die Politikgestaltung im Bereich des Migrationsmanagements prägt, zielen die KI-gestützte verbesserte Überwachung und Risikobewertung darauf ab, irreguläre Grenzübertritte oder gefälschte Dokumente aufzudecken. Schließlich ist auch die Vorhersagekraft der KI verlockend, da KI-gestützte Prognosen als Möglichkeit dargestellt werden, sich auf umfangreiche Migrationsbewegungen vorzubereiten, humanitäre Maßnahmen zu unterstützen und Ressourcen besser zu verteilen.

Mit solchen Vorteilen vor Augen werden von Staaten und der Privatwirtschaft Investitionen in KI begründet, mit dem Ziel sogenannter „intelligenter Grenzen“ (smart borders). Diese sollen sowohl sicher als auch technologisch fortschrittlich sein. In Deutschland werden solche Innovationen auch als Teil einer umfassenderen Digitalisierung des Migrationsmanagements angesehen, die mit den EU-Strategien für die digitale Transformation im Einklang steht.

Herausforderungen und Kritik

Trotz dieser Versprechen argumentieren Akteure aus der Zivilgesellschaft, Forschende und Betroffenen, dass der Einsatz von KI im Migrationsmanagement ernsthafte ethische und rechtliche Risiken birgt. Beispielsweise können KI-Systeme Diskriminierung und systemischen Rassismus verschärfen, da sie oft die Vorurteile in den Daten widerspiegeln, mit denen sie trainiert wurden. So ist etwa die Gesichtserkennung bei Menschen mit dunklerer Hautfarbe weniger genau, was das Risiko für Fehler bei ihrer Identifizierung erhöht. Risikobewertungssysteme können Angehörige bestimmter Nationalitäten oder ethnischer Gruppen unverhältnismäßig stark benachteiligen. Außerdem mangelt es erheblich an Transparenz bei der Entwicklung und dem Einsatz neuer Technologien. Bei vielen KI-Systemen weiß die Öffentlichkeit nur wenig darüber, wie sie ihre Entscheidungen treffen. Diese Undurchsichtigkeit untergräbt die Rechenschaftspflicht und macht es für Betroffene schwierig, schädliche Folgen anzufechten, wenn Fehler gemacht werden.

Hightech-Flüchtlingslager auf der griechischen Insel Kos. (© Petra Molnar)

Auch die Rechte auf Privatsphäre und Datenschutz sind betroffen: Werden biometrische und personenbezogene Daten gesammelt, gespeichert und analysiert, birgt dies erhebliche Risiken für die Privatsphäre, insbesondere wenn es um sensible Daten von marginalisierten Gruppen wie Menschen auf der Flucht geht. Die unbefugte Weitergabe von Daten und Hackerangriffe sind ebenfalls reale Bedrohungen. Zudem können Menschen auf der Flucht, die sich in einer prekären Lage befinden, oft keine sinnvolle Einwilligung in die Erfassung und den Umgang mit ihren Daten geben.

Rechtlich gesehen können KI- und Überwachungstechnologien, die Menschen daran hindern in Sicherheit zu gelangen, das bestehende Recht auf Asyl untergraben. Automatisierte Entscheidungen können außerdem dazu führen, dass Schutz überproportional verweigert wird oder es aufgrund fehlerhafter Risikobewertungen zu vermehrten Inhaftierungen kommt. Rechtliche Risiken dieser Art stünden im Widerspruch zum geltenden Völkerrecht, das eine individuelle Prüfung von Asylgesuchen und das Non-Refoulement-Prinzip

beinhaltet. Auch ist oft unklar, wer für durch KI verursachte Schäden verantwortlich ist und haftbar gemacht werden kann – der Staat, ein Auftragnehmer, der Softwareentwickler oder die Person bei der Einwanderungsbehörde, die die Anwendung verwendet? Oft ist der Rechtsschutz in diesem neueren Bereich wenig ausgeprägt, was das Einlegen von Rechtsmitteln erschwert – insbesondere in Grenzgebieten, die bereits von intransparenten und ermessensabhängigen Entscheidungen geprägt sind.

Rechtliche Rahmenbedingungen und Kontrolle

Derzeit ist die globale Regulierung im Bereich der KI noch schwach, wobei Innovationen Vorrang vor rechtsbasierten Ansätzen für digitale Grenzkontrolltechnologien haben. Allerdings gelten mehrere internationale und regionale Rechtsinstrumente für den KI-Einsatz im Migrationsbereich. So schützt beispielsweise der Internationale Pakt über bürgerliche und politische Rechte (ICCPR) das Recht auf Privatsphäre (Artikel 17) und das Recht auf Freiheit und Sicherheit (Artikel 9). Diese Rechte müssen im Migrationskontext auch bei der Anwendung von Technologien gewahrt werden. Die Genfer Flüchtlingskonvention von 1951 verpflichtet die Staaten zudem, Zugang zu Asyl zu gewähren und verbietet die Zurückweisung in Gebiete, in denen den betroffenen Personen Folter oder unmenschliche oder erniedrigende Behandlung drohen (Artikel 33). Automatisierte Entscheidungen, die den Zugang zum Asylbegehren blockieren, können gegen diese Schutzbestimmungen verstoßen. Nach EU-Recht regelt die Datenschutz-Grundverordnung (DSGVO) die Datenverarbeitung, einschließlich biometrischer Daten, und die EU-Grundrechtecharta garantiert das Recht auf Privatsphäre, Datenschutz und Nichtdiskriminierung. Vor kurzem hat die EU das Gesetz zur Regulierung künstlicher Intelligenz verabschiedet. Allerdings liegt hier nicht der Schutz der Rechte von Menschen auf der Flucht im Fokus.

Deutschland unterliegt als EU-Mitgliedstaat diesen rechtlichen Rahmenbedingungen, entwickelt jedoch auch eigene Durchführungsbestimmungen. Zivilgesellschaftliche Organisationen, die sich für die Rechte von Flüchtlingen und Migrant:innen einsetzen, haben mehr Transparenz hinsichtlich des Einsatzes von KI in der deutschen Migrationspolitik gefordert, darunter die Offenlegung von Verträgen und Folgenabschätzungen. Die Kontrolle in der Praxis bleibt jedoch begrenzt. Grenzgebiete unterliegen oft Notfall- oder Ausnahmeregelungen. Zudem können private Unternehmen Technologien durch Geschäftsgeheimnisse schützen. Unabhängige systematische Überprüfungen, Folgenabschätzungen und Kontrollmöglichkeiten sind jedoch für eine rechtskonforme Entwicklung und den Einsatz von Technologien an den Grenzen und zur Steuerung der Migration notwendig.

Ausblick

In einer von technologischem Fortschritt geprägten Welt, wird KI voraussichtlich eine immer wichtigere Rolle im Migrationsmanagement spielen. So werden beispielsweise das künftige Einreise-/Ausreisesystem (EES) der EU und das Europäische Reiseinformations- und -genehmigungssystem (ETIAS) KI für das Erstellen von Risikoprofilen und automatisierte Grenzkontrollen nutzen. Projekte zur Emotionserkennung, KI-Lügendetektoren und vorausschauender Polizeiarbeit wurden ebenfalls bereits getestet, allerdings auch weithin kritisiert.

Das ehemalige Flüchtlingslager auf Samos, Griechenland. (© Petra Molnar)

Wissenschaftler:innen und Menschenrechtsorganisationen fordern einen vorsorgenden Ansatz: gründliche Tests, um zu gewährleisten, dass Menschenrechte eingehalten werden, Transparenz und Kontrollmechanismen sowie eine breite öffentliche Debatte, bevor Technologien eingeführt werden. Einige Akteur:innen, darunter das Büro des Hochkommissars der Vereinten Nationen für Menschenrechte (OHCHR), schlagen ein vorübergehendes Aussetzen bestimmter Migrationstechnologien vor, insbesondere in Hochrisikosituationen. Vor allem aber werden die künftigen Entwicklungen der KI im Bereich Migration und an den Grenzen nicht nur von rechtlichen Garantien und demokratischer Rechenschaftspflicht abhängen, sondern auch davon, dass die menschlichen Kosten dieser Technologien anerkannt werden. KI-Systeme sind keine abstrakten Werkzeuge. Sie wirken sich auf reale Menschen aus, die sich oft in prekären und unsicheren Situationen befinden. Es ist wichtig, die Erfahrungen und Rechte von Menschen auf der Flucht in Diskussionen über den Einsatz von KI einzubeziehen.

KI-Anwendungen für das Migrationsmanagement werfen tiefgreifende rechtliche, ethische und soziale Fragen auf. Wenn Regierungen neue Technologien einführen, gilt es sicherzustellen, dass Effizienz und Sicherheit mit Menschenrechten, Würde und Gerechtigkeit vereinbar bleiben. Im Mittelpunkt dieser Debatten stehen Menschen, nicht nur Datenpunkte. Transparente Regeln, eine strenge Kontrolle und die Verpflichtung zu einem menschenzentrierten Design, das auch das Fachwissen der betroffenen Individuen und Communities berücksichtigt, sollten jede zukünftige Nutzung von KI im Migrationsbereich leiten.

Übersetzung aus dem Englischen: Vera Hanewinkel

Fussnoten/Quellen/Literatur

Petra Molnar, The Walls Have Eyes: Surviving Migration in the Age of Artificial Intelligence (2024)

Petra Molnar im Gespräch mit Benjamin Etzold über „intelligente Grenzen“: „Keines dieser KI-gestützten Instrumente ist neutral. Sie dienen einem bestimmten Zweck – der Ausgrenzung.“ (2025)

Mirca Madianou, Technocolonialism: When Technology for Good is Harmful (2024)

OHCHR, Digital Border Governance: A Human Rights Based Approach (2023)

The Migration and Technology Monitor Project

Lizenz

Dieser Text ist unter der Creative Commons Lizenz „CC BY-NC-ND 4.0 – Namensnennung – Nicht kommerziell – Keine Bearbeitungen 4.0 International“ veröffentlicht. Autor/-in: Petra Molnar für bpb.de. Sie dürfen den Text unter Nennung der Lizenz CC BY-NC-ND 4.0 und des/der Autors/-in teilen. Urheberrechtliche Angaben zu Bildern / Grafiken / Videos finden sich direkt bei den Abbildungen.

Originalpublikation: https://www.bpb.de/themen/migration-integration/kurzdossiers/migration-und-sicherheit/570377/kuenstliche-intelligenz-im-migrationsmanagement/